1、引言

本文将分别从硬件资源、AI实际能力、价格三方面与英伟达开发板进行对比。

2、硬件资源

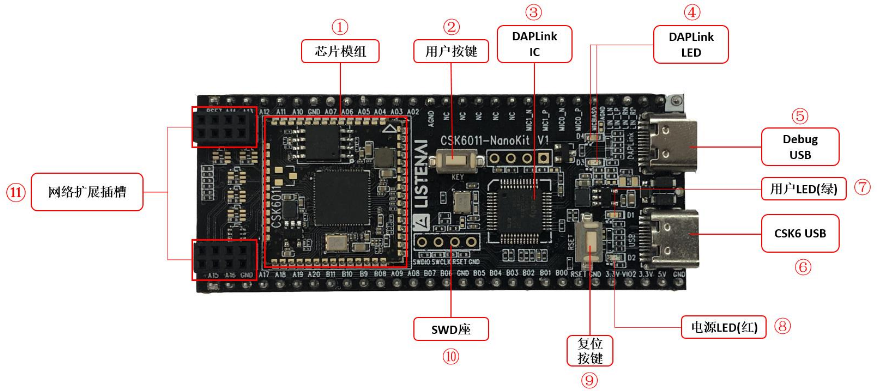

CSK6011-NanoKit V1 开发板板载CSK6011A芯片模组,该芯片是聆思科技新一代的 AI 芯片 SoC 产品系列,采用多核异构架构,集成了 ARM Star MCU,HiFi4 DSP,以及聆思全新设计的 AI 神经网络处理内核 NPU,算力达到 128 GOPS。MCU和DSP的最高主频均达到300Mhz,内置最高支持8MB Flash,1MB SRAM,最高 8MB PSRAM。板载DAPLink调试器IC,外接一条USB 线即可实现供电、烧录、调试、串口监控。

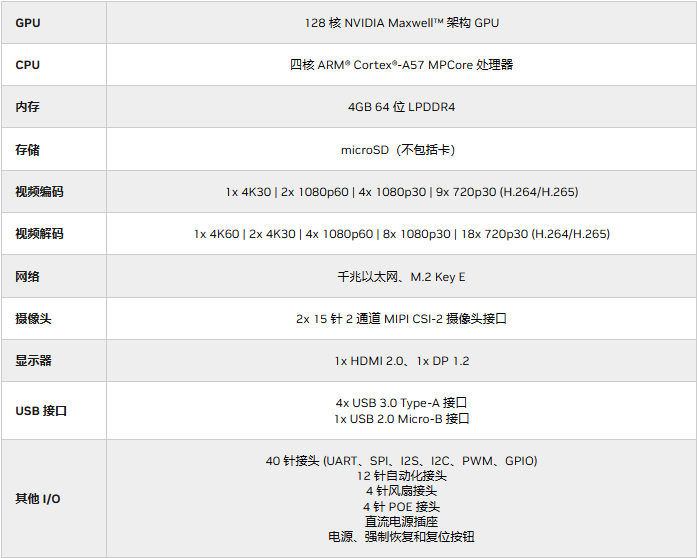

英伟达开发板

Jetson Nano是英伟达公司研制的一款性能强大、体积小巧的智能芯片,其配备了四核Cortex-A57处理芯片,包括4GB LPDDR内存以及128核Maxwell GPU,能够运行多种算法和AI框架,如TensorFlow、Keras、PyTorch、Caffe等,支持NVIDIA JetPack,支持多个神经网络并行运行实现图像分类、人脸识别、语音处理、目标检测及物体识别追踪等,适用于开发小结构、低成本、低能耗的设备。其具体配置如下表所示。

3、AI能力对比

3.1csk6头肩&手势识别体验

头肩检测:检测图像中所有人体的头肩位置,返回每个头肩的唯一id、位置坐标、检测得分等;手势识别:通过头肩检测识别用户的手势,返回当前目标的手势、得分等;支持5种手势,分别为LIKE()、OK()、STOP()、YES()、SIX();

案例体验:官网的教程非常详细,很细心,在此就不赘述了。

放几张实图。

可以看到都能很好的识别。

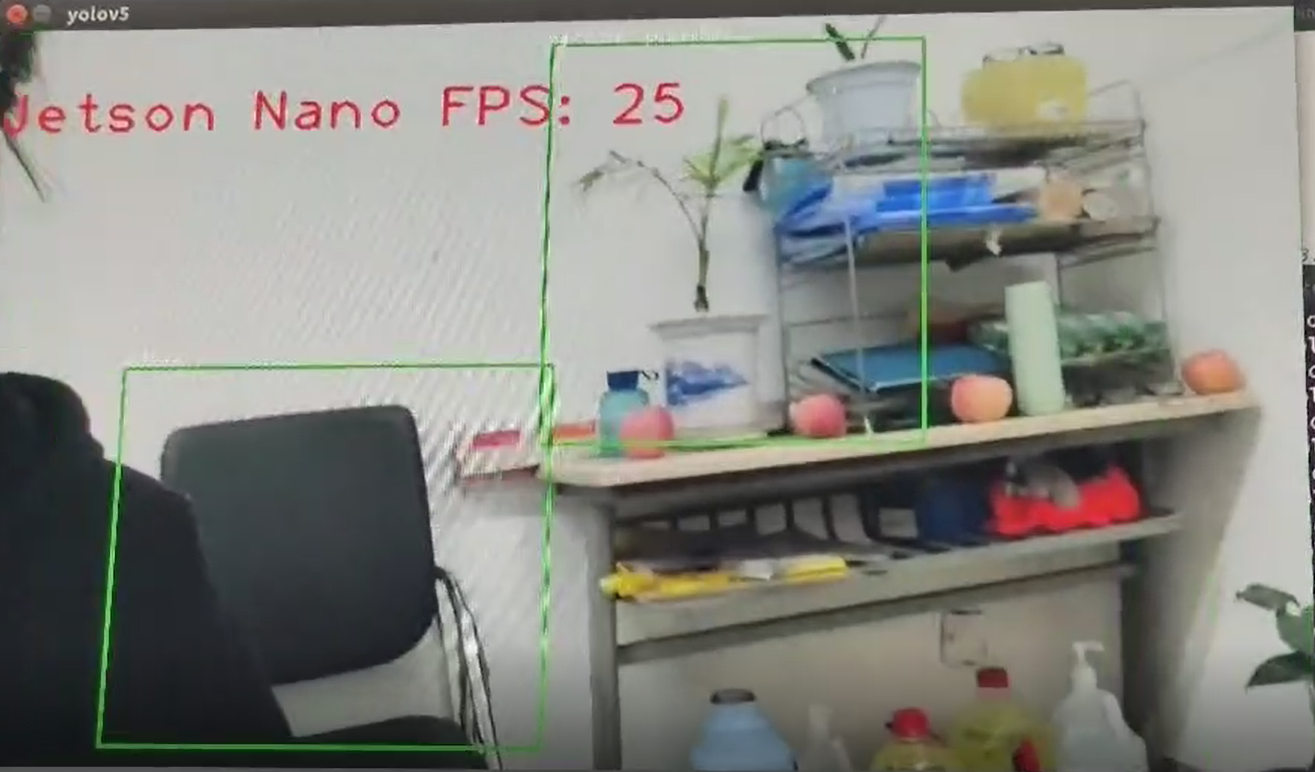

3.2 Jeston nano 目标检测

学习使用Jeston nano 的过程和树莓派有些相似。先要通过镜像烧录工具写入对应的系统镜像。由于要部署的是用pytorch框架写的yolov5网络。所以要配置python、pytorch、cuda环境。

经历以上漫长的过程,然后接下来的步骤是把自己预先训练好的网络模型使用tensorrtx引擎加速推理。生成部署引擎前,还可以选择参数精度fp16还是fp32 int8、device(选择哪一个GPU设备)、nms_thresh(nms的阈值)、conf_thresh(conf的置信度)、batch_size(批次大小)等参数。

然后新建一个文件夹,执行cmake编译命令就行。

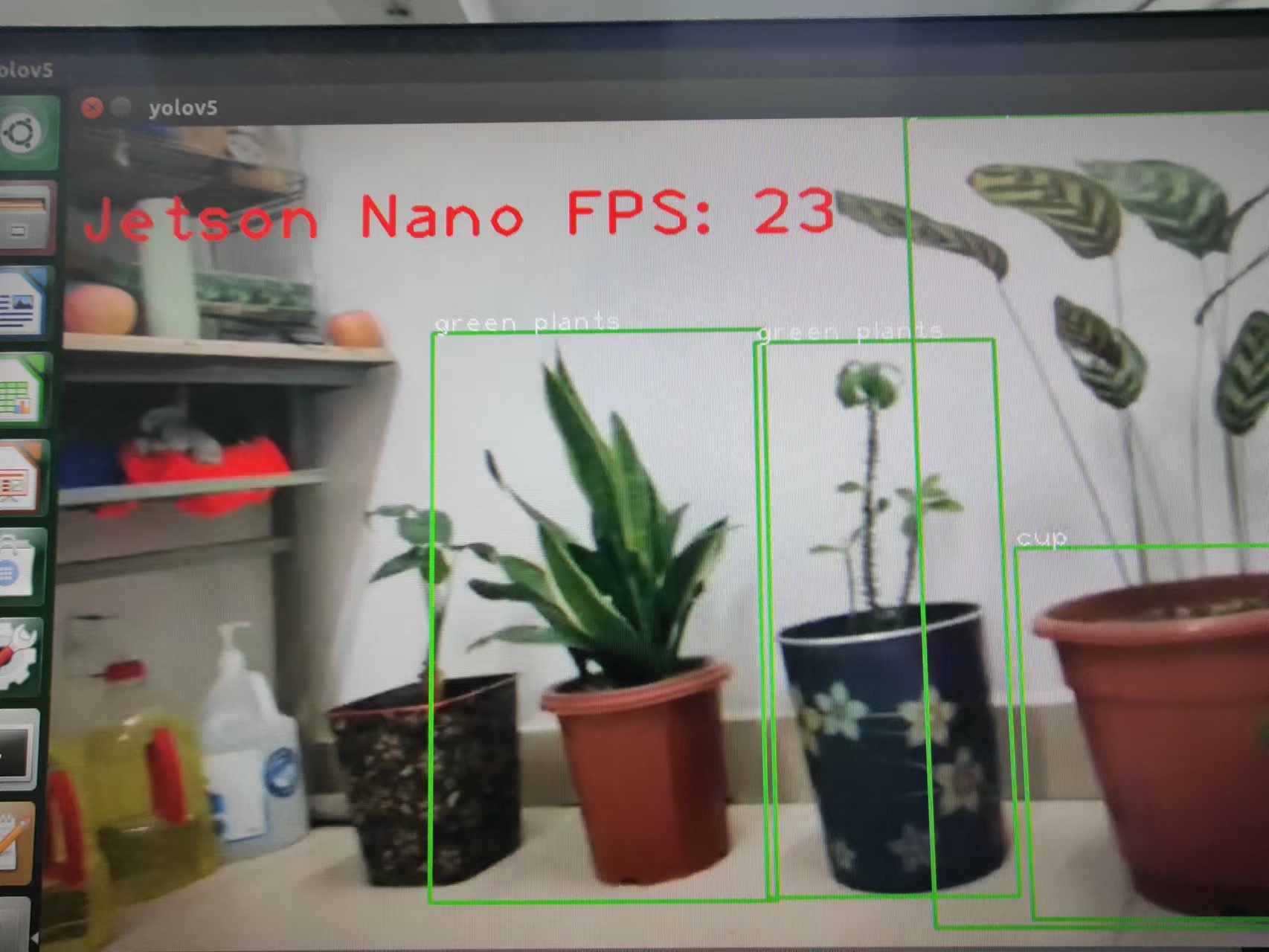

检测效果如下所示。

实际上,因为训练的数据集是COCO数据集,里面的类别如person、chair、cup、car等都可以检测识别。这里仅仅以plant为例。(第二张图有一个实时检测结果误识别了。)

4、实际使用体验

在学习的过程中,Jeston nano 主要靠查一些B站视频和博客,官方支持文档主要是英文的。(英文不好的人留下伤心的泪)。它可以部署自己的网络(前提是网络也不能太大,GPT等大语言模型肯定是不可以的哦),实现目标检测、图像分类等AI能力。CSK6这款板子我学习使用的过程中最大的感觉是省心。第一次跑程序的时候没有使用点亮LED的例子,而是直接体验AI能力。按照官方教程一次性部署成功。在用电脑浏览器预览实时检测画面时出了一些小小的问题,随后也通过更新lisa zep 解决了。更新命令如下。

Lisa zep update

在实际检测过程中,nano 输出的画面质量高一点。虽然检测的对象不同,但是检测的实时性没有感觉到明显差别。我觉得聆思官方工程师对于手势识别、头肩检测的算法应该是花了很多功夫优化。

在价格方面

NVIDIA Jeston nano 基础套装1719 + usb摄像头109 =1828 RMB

CSK6视觉AI套件 248 RMB

ps:nano 购买USB摄像头主要是因为自带的csi摄像头极不稳定。

5、总结

聆思CSK6 视觉AI开发套件对国内开发者而言支持比较好(碎碎念:尤其是英文不好的)。官方文档也很详细。如果使用的是官方支持的AI能力,部署会非常快,而且性能上佳,是极具性价比的选择。AI能力也一直在扩充,最新的还支持了人脸识别功能。

原作者:何夜无月

|  /9

/9